Qu’est-ce qu’un fichier Robots.txt ?

Un fichier Robots.txt est un fichier texte utilisé pour communiquer avec les robots d’indexation et autres agents automatisés sur les pages de votre base de connaissances à ne pas indexer. Il contient des règles précisant quelles pages peuvent être accessibles par quels robots.

NOTE

Pour plus d’informations, lisez cet article d’aide de Google.

Accéder Robots.txt dans Document360

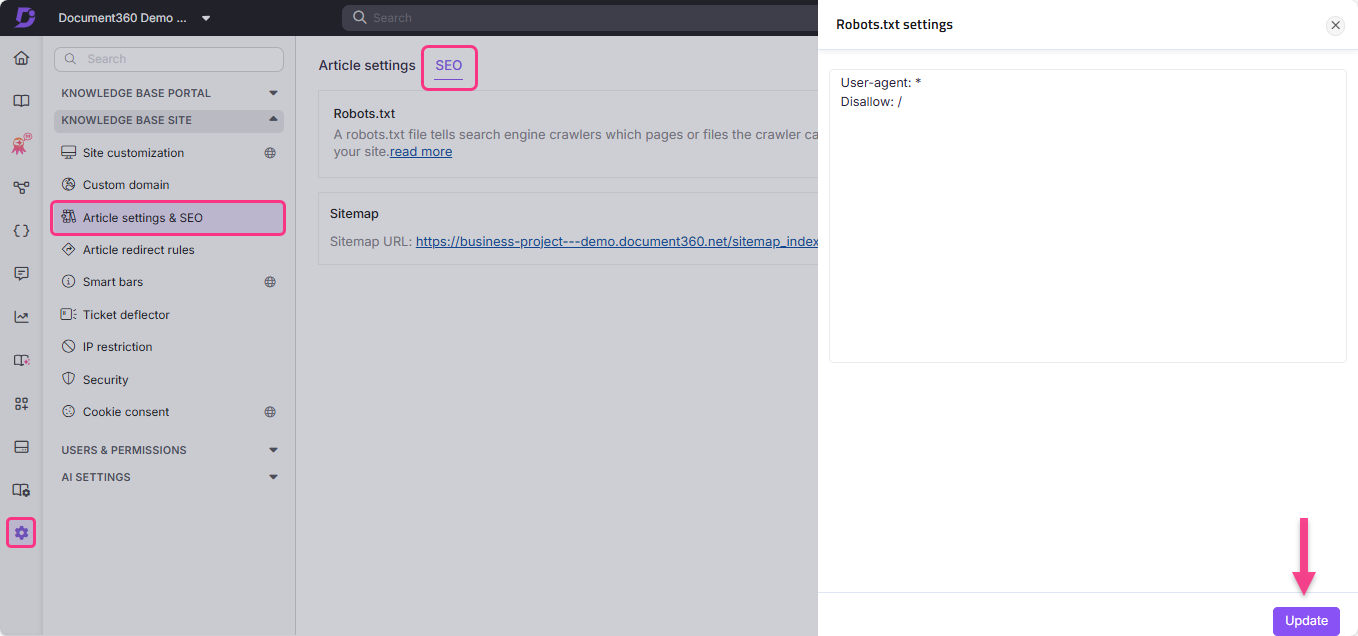

Pour accéder à Robots.txt dans Document360 :

Naviguer dans Paramètres () dans la barre de navigation de gauche

Rendez-vous sur le site de la base de connaissances > Paramètres de l’article et SEO > onglet SEO .

Localisez Robots.txt et cliquez sur Modifier.

Le panneau de réglages Robots.txt apparaîtra.

Tapez les règles que vous souhaitez.

Cliquez sur Mettre à jour.

Cas d’utilisation de Robots.txt

Un fichier Robots.txt peut empêcher qu’un dossier, un fichier (comme un PDF) ou certaines extensions de fichiers ne soient pas explorés.

Vous pouvez aussi retarder la vitesse de crawl des bots en ajoutant du crawl-delay dans votre fichier Robots.txt. C’est utile lorsque votre site connaît un trafic élevé.

User-agent: *

Crawl-delay: 10Restreindre le robot d’indexation via les données d’administration

User-agent: *

Disallow: /admin/

Sitemap: https://example.com/sitemap.xml

User-agent: * - Précise que tout bot peut explorer le site.Disallow: /admin/: - Restreint l’accès aux données d’administration du robot.Sitemap: https://example.com/sitemap.xml - Donne accès aux bots pour explorer le sitemap. Cela facilite l’exploration car le sitemap contient toutes les URL du site.

Restreindre un moteur de recherche spécifique pour ne pas explorer

User-agent: Bingbot

Disallow: /

Le fichier Robots.txt ci-dessus est défini pour interdire le Bingbot.

User-agent: Bingbot - Spécifie le robot d’exploration provenant du moteur de recherche Bing.Disallow: / - Empêche Bingbot d’explorer le site.

Bonnes pratiques

Incluez des liens vers les pages les plus importantes.

Bloquez les liens vers des pages qui n’apportent aucune valeur.

Ajoutez l’emplacement du sitemap dans le fichier Robots.txt .

Un fichier Robots.txt ne peut pas être ajouté deux fois. Veuillez consulter les directives de base de la documentation Google Search Central pour plus d’informations.

NOTE

Un robot d’indexation web, également appelé Spider ou Spiderbot, est un programme ou un script qui navigue automatiquement sur le web et collecte des informations sur divers sites web. Les moteurs de recherche comme Google, Bing et Yandex utilisent des robots d’exploration pour reproduire les informations d’un site sur leurs serveurs.

Les robots d’exploration ouvrent de nouveaux onglets et font défiler le contenu du site web, tout comme un utilisateur qui consulte une page web. De plus, les robots collectent des données ou des métadonnées provenant du site web et d’autres entités (comme des liens sur une page, des liens cassés, des plans de site et du code HTML) et les envoient aux serveurs de leur moteur de recherche respectif. Les moteurs de recherche utilisent ces informations enregistrées pour indexer efficacement les résultats.

FAQ

Comment retirer mon projet Document360 de l’index de recherche Google ?

Pour exclure l’ensemble du projet de l’index de recherche Google :

Naviguez dans Paramètres () dans la barre de navigation de gauche du Knowledge base portal.

Dans le panneau de navigation de gauche, allez vers le site de la base de connaissances > Paramètres d’article et SEO > onglet SEO .

Allez dans l’onglet SEO et cliquez sur Modifier dans le

Robots.txtfichier .Collez le code suivant :

User-Agent: Googlebot

Disallow: Cliquez sur Mettre à jour.

Comment empêcher que les pages de balises soient indexées par les moteurs de recherche ?

Pour exclure les pages de balises des moteurs de recherche :

Naviguez dans Paramètres () dans la barre de navigation de gauche.

Rendez-vous sur le site de la base de connaissances > Paramètres d’articles et SEO > onglet SEO .

Cliquez sur Modifier dans le

Robots.txtfichier .Collez le code suivant :

User-agent: *

Disallow: /docs/en/tags/Cliquez sur Mettre à jour.